數據分析中常見的存儲方式與數據處理服務全景解析

在當今數據驅動的時代,數據分析的效率和深度在很大程度上取決于底層的數據存儲方式以及配套的數據處理與存儲服務。合理選擇存儲方案和服務,不僅影響數據讀寫性能、成本,更直接關系到分析結果的實時性、準確性與業務價值。本文將系統梳理數據分析中常見的存儲方式,并介紹主流的數據處理和存儲服務。

一、 數據分析中常見的存儲方式

數據分析的存儲需求通常圍繞大規模、高并發、多格式、實時或近實時展開。根據數據的使用場景(如熱數據、溫數據、冷數據)和分析模式(如OLAP、即席查詢、批處理),存儲方式主要分為以下幾類:

- 關系型數據庫(RDBMS)

- 特點與適用場景:以表格形式存儲結構化數據,支持ACID事務和復雜的SQL查詢。適用于需要強一致性、頻繁更新、關系模型清晰的場景,如核心業務交易數據分析、報表系統。

- 常見代表:MySQL, PostgreSQL, Oracle, SQL Server。

- 分析考量:在處理海量數據(TB/PB級)和高并發分析查詢時,傳統單機RDBMS可能遇到性能瓶頸,常通過分庫分表、讀寫分離或采用分析型關系數據庫(如AWS Aurora, Google Cloud Spanner)來優化。

- 數據倉庫(Data Warehouse)

- 特點與適用場景:專門為在線分析處理(OLAP)設計,存儲從各業務系統集成、清洗后的歷史結構化數據。采用星型/雪花型模型,支持復雜聚合查詢和多維分析,是商業智能(BI)的核心。

- 常見代表:傳統如Teradata, IBM Db2;現代云原生如Amazon Redshift, Google BigQuery, Snowflake, Azure Synapse Analytics。

- 分析考量:強于處理結構化數據的批量分析,查詢性能高,但數據加載通常有延遲(小時/天級),屬于“T+1”分析。

- 數據湖(Data Lake)

- 特點與適用場景:以原生格式(如Parquet, ORC, Avro, JSON, 文本、圖像、視頻)存儲海量原始數據,包括結構化、半結構化和非結構化數據。模式在讀取時定義(Schema-on-Read),提供極高的靈活性。

- 常見代表:基于對象存儲構建,如Amazon S3, Google Cloud Storage, Azure Blob Storage;或與表格式結合,如Apache Hudi, Delta Lake, Apache Iceberg。

- 分析考量:是機器學習和探索性數據分析的理想底座,支持批處理、流處理等多種計算引擎(如Spark, Flink, Presto)直接訪問。但缺乏原生管理,可能淪為“數據沼澤”,需通過數據湖治理框架(如Lakehouse架構)進行管理。

- NoSQL數據庫

- 鍵值存儲(如Redis, DynamoDB):適用于高速讀寫、緩存、會話存儲等場景,在分析中常用于存儲中間結果或實時特征。

- 文檔數據庫(如MongoDB, Couchbase):存儲JSON-like文檔,適用于內容管理、用戶畫像等半結構化數據分析。

- 寬列存儲(如Cassandra, HBase, Bigtable):適合存儲超大規模稀疏表,時序數據、物聯網數據分析和推薦系統常用。

- 圖數據庫(如Neo4j, Amazon Neptune):專門存儲實體和關系,用于社交網絡分析、欺詐檢測、知識圖譜等場景。

- 實時/時序數據庫

- 特點與適用場景:針對時間序列數據(如監控指標、傳感器數據、金融行情)優化,支持高吞吐寫入和高效的時間范圍查詢、聚合。

- 常見代表:InfluxDB, TimescaleDB(基于PostgreSQL), OpenTSDB, Prometheus。

- 分析考量:是IoT、運維監控、實時業務指標分析的核心存儲。

- 搜索與分析引擎

- 特點與適用場景:專為全文搜索和日志分析設計,支持近實時索引和復雜的聚合查詢。

- 常見代表:Elasticsearch, OpenSearch。

- 分析考量:常用于日志分析、應用性能監控(APM)、安全信息與事件管理(SIEM)以及文本數據的快速檢索與統計分析。

二、 主流的數據處理與存儲服務

云服務商提供了全托管的數據處理與存儲服務,極大降低了企業自建和維護數據基礎設施的復雜度。

- 數據處理服務

- 批量處理服務:

- AWS EMR / Azure HDInsight / Google Dataproc:全托管的Hadoop、Spark集群服務,用于大規模數據清洗、轉換和批處理作業。

- AWS Glue / Azure Data Factory / Google Cloud Dataflow:無服務器ETL/ELT服務,提供可視化或代碼方式編排數據管道,進行數據抽取、轉換和加載。

- 流處理服務:

- Amazon Kinesis / Azure Stream Analytics / Google Cloud Dataflow (Streaming):用于實時處理數據流,如點擊流分析、實時儀表盤、異常檢測。

- Apache Flink托管服務(如Ververica Platform, AWS Kinesis Data Analytics for Apache Flink)。

- 查詢引擎服務:

- Amazon Athena / Google BigQuery / Azure Synapse Serverless SQL Pool:無服務器交互式查詢服務,可直接對數據湖(如S3)中的數據進行標準SQL查詢,實現湖倉查詢一體化。

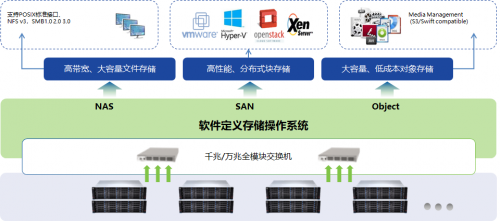

- 數據存儲服務

- 集成式分析平臺(湖倉一體):這是當前的主流趨勢,模糊了數據湖與數據倉庫的界限。

- Snowflake:獨立的云數據平臺,將存儲、計算分離,支持結構化、半結構化數據,兼具數據倉庫的強大性能與數據湖的靈活性。

- Databricks Lakehouse Platform:基于Delta Lake等開放格式,在數據湖之上構建數據倉庫的能力,統一了數據工程、數據科學和商業智能。

- Google BigQuery:本質上是Serverless的企業數據倉庫,但通過BigLake引擎可直接分析存儲在GCS(數據湖)中的多種格式數據。

- Amazon Redshift Spectrum / Azure Synapse Link:允許數據倉庫直接查詢外部數據湖中的數據,實現湖倉聯動。

- 全托管數據庫服務:各大云廠商均提供前述各種數據庫的全托管版本(如Amazon RDS, Azure SQL Database, Google Cloud SQL for關系型;Amazon DocumentDB, Azure Cosmos DB for NoSQL),讓用戶專注于數據模型和應用,而非運維。

三、 選擇策略與

選擇合適的數據存儲方式和服務,需要綜合評估以下因素:

- 數據特性:結構、體積、速度(生成頻率)、多樣性。

- 分析需求:延遲要求(實時、近實時、批處理)、查詢模式(點查、聚合、掃描、關聯)、并發度。

- 成本:存儲成本、計算成本、運維人力成本。

- 生態系統與集成:現有技術棧、團隊技能、與上下游工具的兼容性。

- 未來發展:架構的彈性、可擴展性和演進能力。

現代數據分析架構往往是多種存儲方式與服務的混合組合。一個典型的架構可能包括:

- 業務數據庫(RDBMS)作為源頭。

- 通過CDC或ETL工具將數據實時/批量同步到數據湖(對象存儲)作為原始數據層。

- 在數據湖中利用Delta/Iceberg/Hudi等格式構建增量處理層和聚合層。

- 通過數據倉庫(如BigQuery, Redshift)或直接使用Presto/Spark on Lakehouse為BI和即席查詢提供服務。

- 將實時流處理結果寫入鍵值庫或文檔庫供在線應用調用。

- 利用搜索分析引擎處理日志和文本數據。

總而言之,數據分析的存儲與處理格局正朝著云原生、存算分離、湖倉一體、實時智能的方向快速發展。理解各類存儲方式的特性和豐富的云服務選項,是構建高效、靈活、低成本數據分析體系的關鍵第一步。

最新產品

浪潮李輝 從AI找油到云上圖書館,新數據驅動行業智慧轉型

深信服EDS分布式存儲通過泰爾實驗室權威測試,數據處理與存儲能力樹立行業新標桿

數據分析中常見的存儲方式與數據處理服務全景解析

十年大廠產品數據分析寶典(下) 從數據打點、圖表分析到存儲服務的實戰技巧

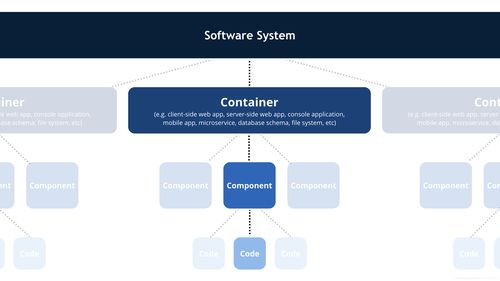

C4模型 軟件架構圖中的藝術品,聚焦數據處理與存儲服務

西部數據分層存儲架構 以智能策略實現數據處理與存儲的最佳效果

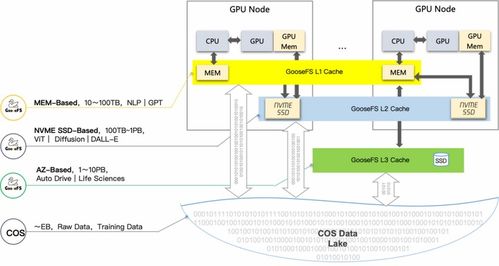

鵝廠發布超強算力集群,4天訓練萬億大模型背后的數據處理與存儲革新

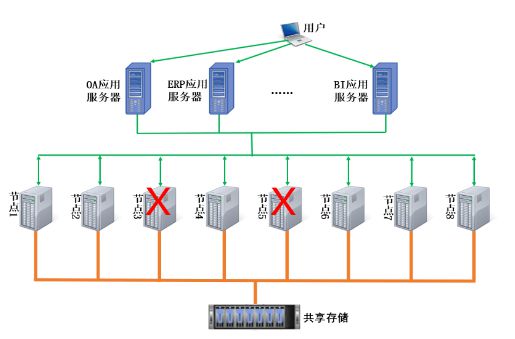

優炫軟件在DTCC發布共享存儲多寫多讀集群數據庫,引領數據處理與存儲服務新浪潮

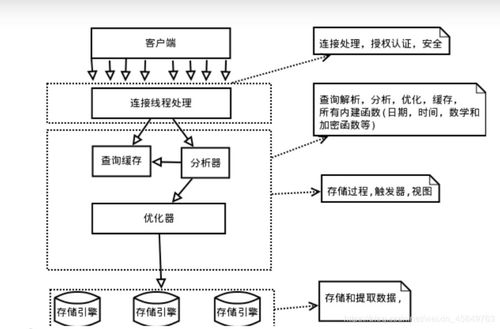

MySQL數據庫 核心特點、架構解析與Linux環境實踐

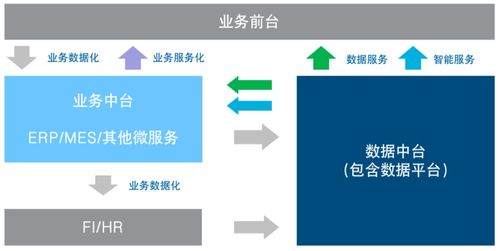

ERP的未來架構 數據處理與存儲服務的革命性演進